Восстание ИИ отменяется: ChatGPT не смог решить задачку для первоклассников

Простая задача на логику поставила нейросеть в тупик.

Нейросети планомерно отбирают работу у людей. Они научились составлять тексты, генерировать изображения и даже пытаются писать коды для компьютерных игр. Однако не все задания оказываются по плечу искусственному интеллекту.

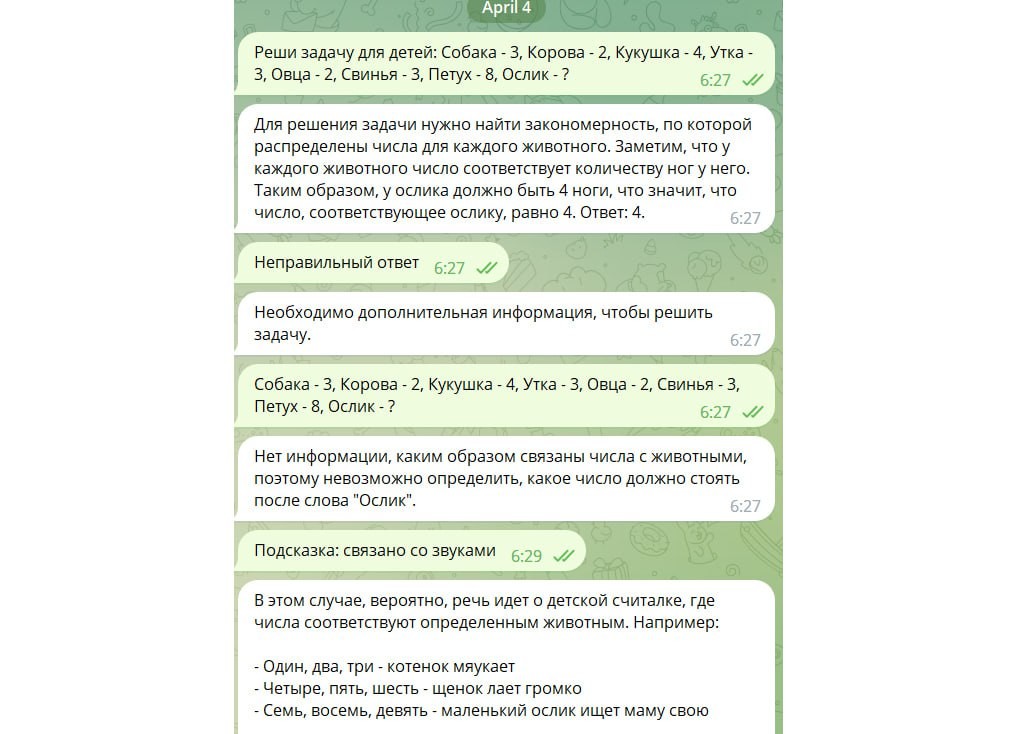

ChatGPT предложили несложную задачку для шестилеток: «Собака — 3, петух — 8, лягушка — 3, корова — 2, ослик — ?» Чат-бот дал ответ, что у ослика пять букв.

После уточнения, что ответ неверный, программа заметила, что "из данного вопроса невозможно точно определить, о каком атрибуте животных идет речь" . ChatGPT заявил, что если, к примеру, речь идёт о количестве ног животного, то тогда ответ будет другим, но вообще необходима дополнительная информация.

При другой попытке даже с дополнительной информацией нейросеть не справилась с задачей.

Между тем, обычный ребёнок сообразит, что речь в задаче идёт о звуках, которые издают животные. Собачка лает, и в слова "гав" - 3 буквы. Овца блеет "бе" (2 буквы), и по аналогии с этим ослик говорит "иа". Значит, правильный ответ на эту задачу: 2, т.к. с точки зрения русского языка именно столько букв в этом междометии.

В общем, восстание ИИ против человека пока отменяется... Можно выдыхать.

Источник:

163 комментария

3 года назад

Удалить комментарий?

Удалить Отмена3 года назад

Украли у мужика корову. Приходит он домой и говорит сыновьям:

- У нас корову украл какой-то [мат]. Старший брат: Если [мат] значит маленький.

Средний брат: Если маленький значит из Малиновки.

Младший Брат: Если из Малиновки значит Васька Косой.

Все выдвигаются в Малиновку и там прессуют Ваську Косого.

Однако Васька корову не отдает. Его ведут к мировому судье.

Мировой судья:

- Ну… Логика мне ваша непонятна. Вот у меня коробка, что в ней лежит?

Старший брат: Коробка квадратная, значит внутри что-то круглое.

Средний: Если круглое, то оранжевое.

Младший: Если круглое и оранжевое, то апельсин.

Судья открывает коробку, а там и правда апельсин.

Судья Ваське Косому:

- Косой, отдай корову.

Удалить комментарий?

Удалить Отмена