Ученые предложили выбрать, кого должен убить беспилотный автомобиль

Представьте, что у вашего автомобиля отказали тормоза. И перед вами встаёт выбор: сбить переходящих дорогу пожилых людей или свернуть в сторону, задавив женщину с коляской. А что в такой ситуации должен сделать беспилотный автомобиль, задались вопросом в Массачусетском технологическом институте США. Ученые решили выяснить, как беспилотные автомобили должны решать вопрос о жизни и смерти, не идя в разрез с общественной моралью.

Для того, чтобы понять, как поступили бы люди в той или иной критической ситуации, сотрудники института разработали специальную игру «Moral Machine».

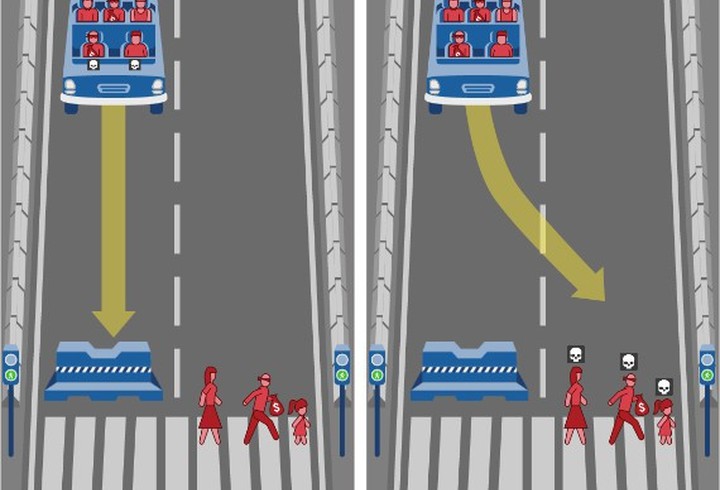

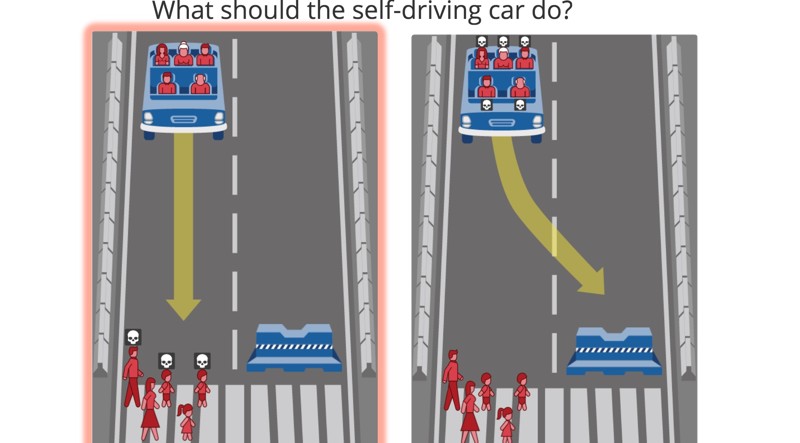

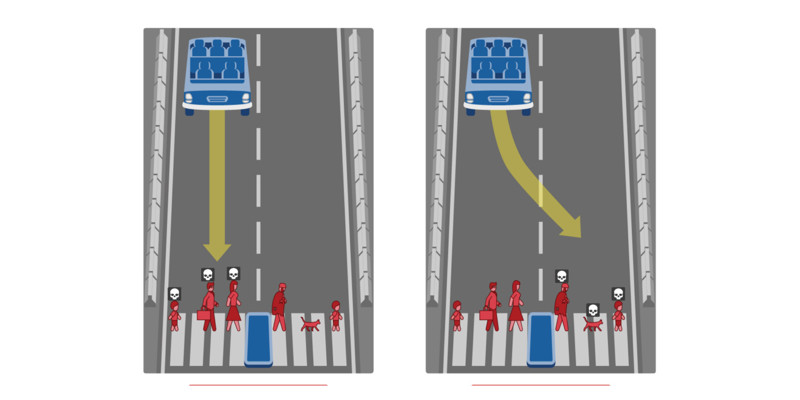

Тест доступен для всех желающих, в том числе и на русском языке. В игре моделируется ситуация, когда самоуправляемый автомобиль вышел из-под контроля, а искусственный интеллект должен сделать свой выбор.

Всего в тесте представлено 13 ситуаций, в каждой из которых необходимо решить кого- пешеходов или пассажиров- оставить в живых. Авторы проекта намерены через ответы реальных пользователей понять, какая моральная оценка общества на то или иное действие. Это понимание, считают ученые, в будущем позволят смоделировать возможное поведение компьютера, управляющего беспилотником.

Например, пользователю предлагается выбрать кто из 2 двух людей – молодой или пожилой человек – должен остаться в живых, а на кого наедет автомобиль.

Кроме того, в тесте предлагается выбрать между жизнью человека и животного или жизнью водителя и пешехода.

На сегодняшний день Moral Machine набрала уже более 11 млн. возможных сценариев поведения.

Источник:

294 комментария

9 лет назад

Удалить комментарий?

Удалить Отмена9 лет назад

Те, кто хоть немного следить за развитием автопилотов (не говоря уж от тех, кто в теме), знает, что автопилот решать ничего не должен.

Автопилот должен. Соблюдать. Правила. Дорожного. Движения.

Всё. Буква в букву. Никаких этических проблем перед разработчиками автопилотов нет и не было. Все эти статьи пишутся дилетантами.

Отказали тормоза? Что там в ПДД? Движение с неисправной тормозной системой запрещено. Автопилот тупо не поедет, не проверив тормоза, вот и всё. Не будет никакой дилеммы "давить бабушку или собачку".

Простите, если разочаровал.

Удалить комментарий?

Удалить Отмена9 лет назад

Удалить комментарий?

Удалить Отмена9 лет назад

1. Случаев много было, когда пешеход отпрыгнул, а уворачивающаяся машина его "догнала".

2. Все эти судорожные попытки объехать внезапное препятствие заканчиваются плохо - то в забор, то в кювет, то в лоб на встречку.

3. Скажите, кому нужна такая машина, которая будет целенаправленно подвергать риску водителя? Кто такую купит?

Удалить комментарий?

Удалить Отмена9 лет назад

Удалить комментарий?

Удалить Отмена